Lean UX : la méthode qui élimine le superflu de vos projets web

Le Lean UX remplace les livrables lourds par des cycles courts de validation. Découvrez comment appliquer cette méthode à vos projets web pour livrer plus vite et réduire le gaspillage.

Tester l'UX (expérience utilisateur), c'est observer de vrais utilisateurs interagir avec un site ou un prototype pour identifier les frictions et les abandons avant qu'ils ne coûtent des conversions. Le Nielsen Norman Group estime que 5 testeurs suffisent à repérer environ 85% des difficultés d'utilisabilité (NNG, 2000).

Pourtant, la majorité des PME françaises lancent leur site sans un seul test utilisateur. Résultat ? Selon le Baymard Institute (2024), le taux moyen d'abandon de panier avoisine 70% en e-commerce. Ce gaspillage est évitable, et souvent corrigeable en quelques jours.

Ce guide vous donne un protocole complet pour tester l'UX de votre site, des méthodes aux outils, du recrutement de testeurs à l'analyse des résultats. Pas de théorie abstraite : des actions que vous pouvez lancer cette semaine. Que votre site soit un e-commerce, un SaaS ou un site vitrine, les principes restent les mêmes. Seuls les parcours à tester changent.

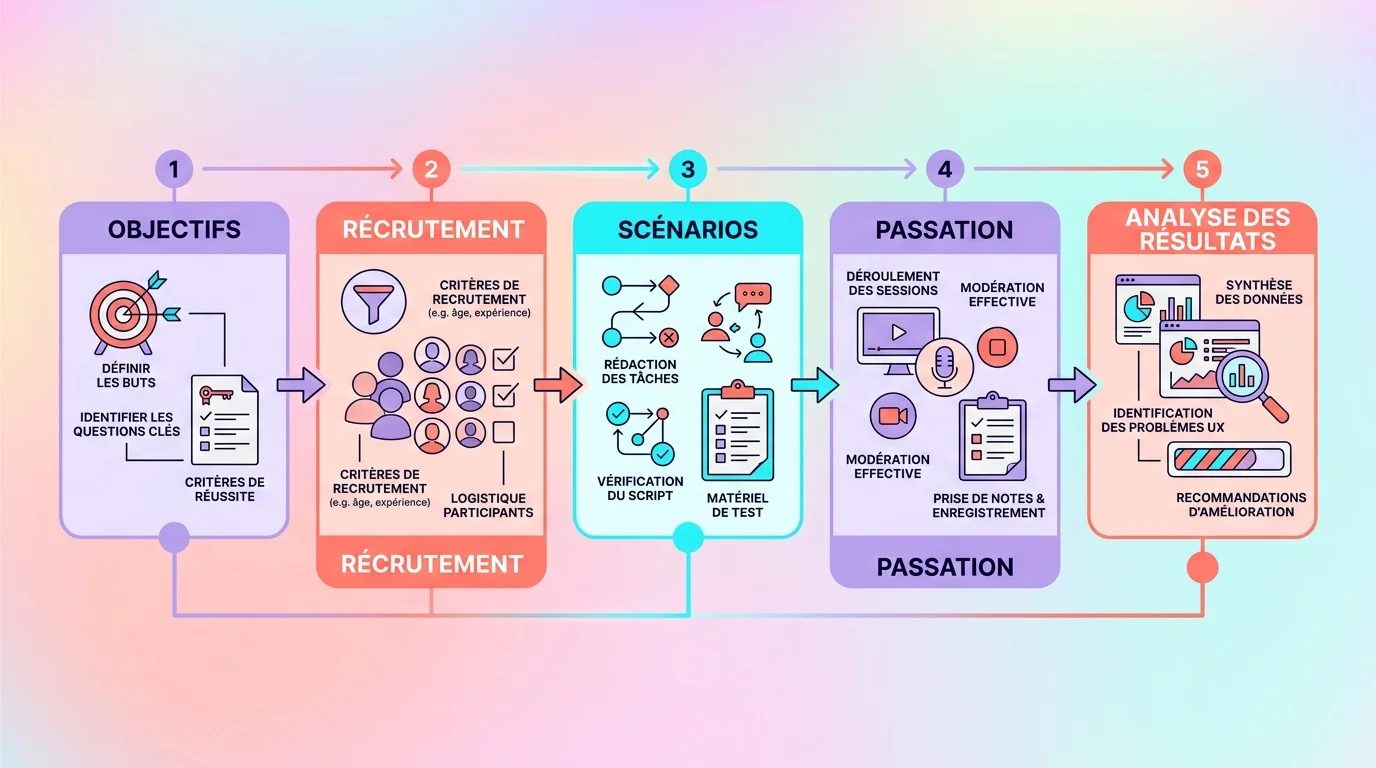

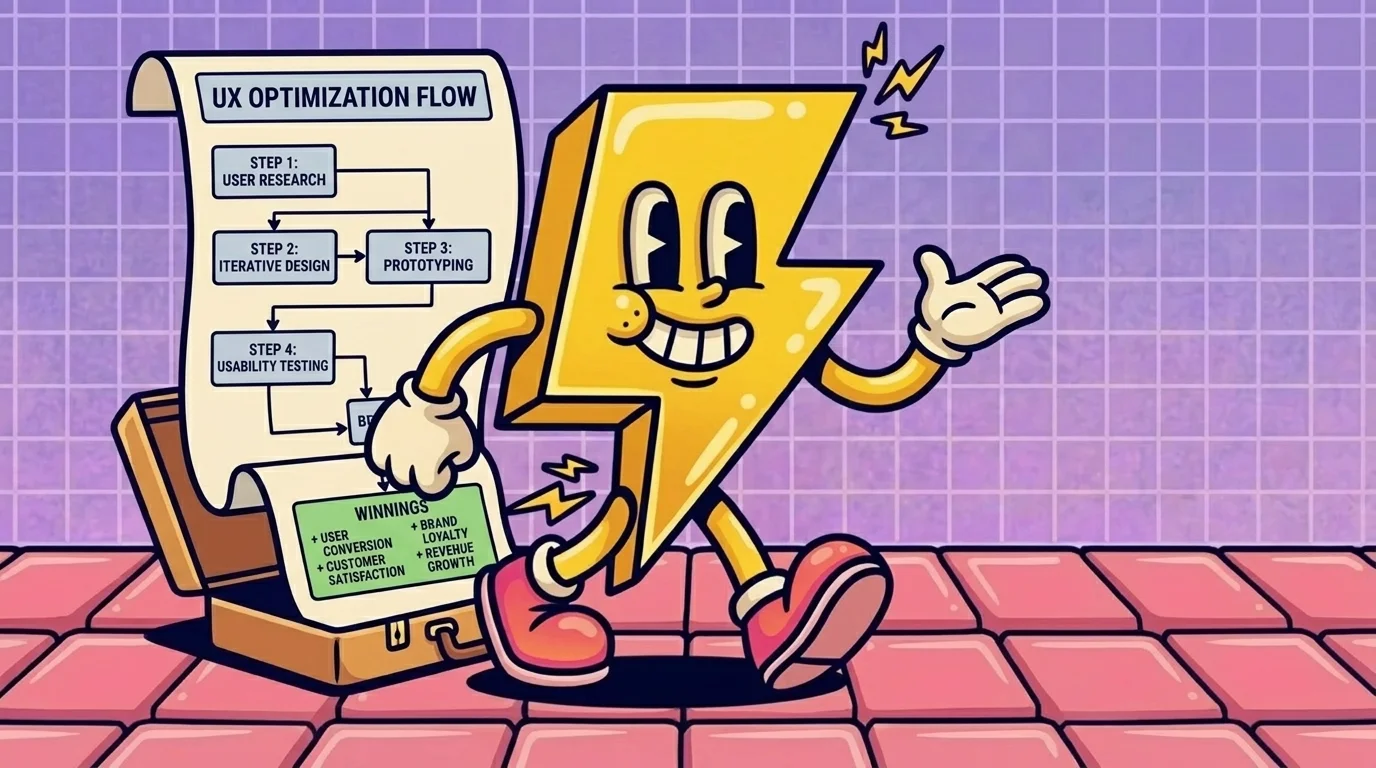

Commençons par ce qui vous intéresse : la méthode. Un test UX réussi suit un processus précis en cinq phases. Sauter une étape, c'est risquer de collecter des données inutilisables, et perdre du temps sur des corrections mal ciblées. Ce protocole s'applique aussi bien à un test modéré en présentiel qu'à un test non-modéré à distance. Il fonctionne pour un site e-commerce, un SaaS, un site vitrine ou même un prototype Figma.

L'erreur la plus courante chez les PME qui découvrent les tests UX ? Lancer des sessions sans objectif clair. « Tester le site » n'est pas un objectif. « Vérifier que la majorité des testeurs complètent le tunnel d'achat en moins de 3 minutes » en est un. Chaque phase décrite ci-dessous sert à cadrer votre démarche pour en tirer des insights exploitables, pas juste des vidéos de sessions qui prennent la poussière sur un drive partagé. Suivez l'ordre, les raccourcis coûtent plus cher qu'ils n'en font gagner.

Que voulez-vous vérifier ? « Les utilisateurs trouvent-ils le bouton d'ajout au panier en moins de 10 secondes ? » est un bon objectif. « Tester le site » ne l'est pas. Formulez 3 à 5 hypothèses précises liées à des parcours critiques, tunnel d'achat, formulaire de contact, navigation principale. Chaque hypothèse doit être mesurable : temps de réalisation, taux de succès, nombre d'erreurs.

Le chiffre vient du Nielsen Norman Group (NNG, 2000) : 5 testeurs détectent environ 85% des difficultés. Au-delà de 8, le ratio découverte/coût chute. Recrutez dans votre cible réelle, pas vos collègues. Utilisez votre base CRM, un panel externe (TestingTime, Respondent) ou même LinkedIn. Budget : entre 30 et 80 € par testeur pour une session de 30 minutes.

Un scénario = une mise en situation + une tâche concrète. Exemple : « Vous cherchez un cadeau pour un ami qui aime la randonnée. Trouvez un sac à dos adapté et ajoutez-le au panier. » Évitez les termes de votre interface dans la consigne, le testeur doit naviguer seul, sans indice. Préparez 4 à 6 scénarios par session, du plus simple au plus complexe.

Modéré ou non-modéré, en présentiel ou à distance, le format dépend de vos moyens et objectifs. Pendant la session, observez sans intervenir. Notez les hésitations, les clics erronés, les commentaires spontanés. Demandez au testeur de « penser tout haut » (think-aloud protocol) : cette verbalisation révèle le raisonnement derrière chaque action. Enregistrez systématiquement l'écran et l'audio.

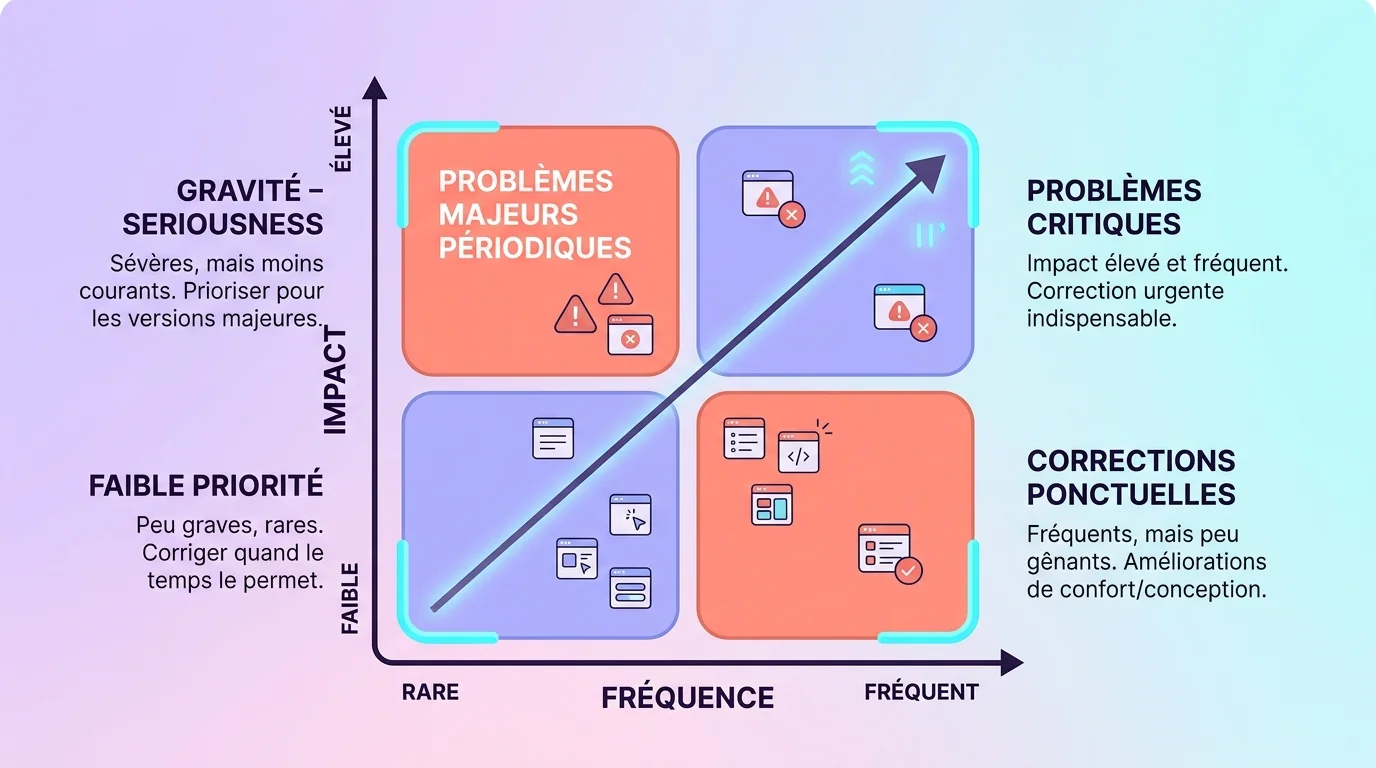

Regroupez les observations par thème : navigation, compréhension du contenu, performance des formulaires, lisibilité. Classez chaque problème selon deux axes, fréquence (combien de testeurs l'ont rencontré) et impact (blocage total vs friction mineure). Les problèmes fréquents ET bloquants passent en priorité 1. Livrez un rapport avec captures d'écran annotées et recommandations concrètes.

Que voulez-vous vérifier ? « Les utilisateurs trouvent-ils le bouton d'ajout au panier en moins de 10 secondes ? » est un bon objectif. « Tester le site » ne l'est pas. Formulez 3 à 5 hypothèses précises liées à des parcours critiques, tunnel d'achat, formulaire de contact, navigation principale. Chaque hypothèse doit être mesurable : temps de réalisation, taux de succès, nombre d'erreurs.

Le chiffre vient du Nielsen Norman Group (NNG, 2000) : 5 testeurs détectent environ 85% des difficultés. Au-delà de 8, le ratio découverte/coût chute. Recrutez dans votre cible réelle, pas vos collègues. Utilisez votre base CRM, un panel externe (TestingTime, Respondent) ou même LinkedIn. Budget : entre 30 et 80 € par testeur pour une session de 30 minutes.

Un scénario = une mise en situation + une tâche concrète. Exemple : « Vous cherchez un cadeau pour un ami qui aime la randonnée. Trouvez un sac à dos adapté et ajoutez-le au panier. » Évitez les termes de votre interface dans la consigne, le testeur doit naviguer seul, sans indice. Préparez 4 à 6 scénarios par session, du plus simple au plus complexe.

Modéré ou non-modéré, en présentiel ou à distance, le format dépend de vos moyens et objectifs. Pendant la session, observez sans intervenir. Notez les hésitations, les clics erronés, les commentaires spontanés. Demandez au testeur de « penser tout haut » (think-aloud protocol) : cette verbalisation révèle le raisonnement derrière chaque action. Enregistrez systématiquement l'écran et l'audio.

Regroupez les observations par thème : navigation, compréhension du contenu, performance des formulaires, lisibilité. Classez chaque problème selon deux axes, fréquence (combien de testeurs l'ont rencontré) et impact (blocage total vs friction mineure). Les problèmes fréquents ET bloquants passent en priorité 1. Livrez un rapport avec captures d'écran annotées et recommandations concrètes.

Un test UX (ou test d'utilisabilité) consiste à placer un utilisateur réel devant votre interface et à observer comment il accomplit des tâches précises. Ce n'est ni un sondage d'opinion, ni un focus group, ni une démonstration produit. C'est une observation empirique de comportements réels dans des conditions proches de l'usage quotidien.

La distinction compte. Un focus group vous dit ce que les gens pensent de votre site. Un test UX vous montre ce qu'ils font réellement dessus. Et les deux divergent souvent, les utilisateurs déclarent « c'est facile » tout en échouant à trouver le formulaire de contact.

Pourquoi maintenant ? Google intègre de plus en plus les signaux d'engagement dans son algorithme. Un site où les utilisateurs galèrent, taux de rebond élevé, temps sur page faible, retour rapide vers les résultats de recherche, perd des positions. Forrester Research estime qu'un dollar investi en UX rapporte entre 10 et 100 dollars en retour. Le test UX n'est plus un luxe réservé aux grands groupes tech.

Pour les PME, les tests utilisateurs représentent le moyen le plus rapide de transformer un site vitrine en outil de conversion. Avant de refondre quoi que ce soit, testez d'abord ce qui existe. Vous serez surpris par ce que 5 sessions de 30 minutes révèlent sur les parcours que vous pensiez « évidents ».

85%

des problèmes détectés avec 5 testeurs, source : Nielsen Norman Group, 2000

10-100x

ROI de chaque dollar investi en UX, source : Forrester Research, 2016

70%

des projets échouent par manque de compréhension utilisateur, source : IBM Design Thinking

69,8%

taux d'abandon moyen des paniers e-commerce, source : Baymard Institute, 2024

Un test UX produit deux types de données. Les données quantitatives, taux de succès, temps de complétion, nombre d'erreurs, taux d'abandon par étape, répondent à « combien » et « à quelle fréquence ». Les données qualitatives, verbalisations du testeur, hésitations observées, commentaires spontanés, expressions faciales, répondent à « pourquoi ».

L'erreur classique : ne collecter que l'un des deux. Un taux de succès de seulement 60% sur votre formulaire de contact vous alerte. Mais sans les verbalisations des testeurs qui ont échoué, vous ne savez pas si le obstacle vient du label d'un champ, de la longueur du formulaire ou d'un bouton invisible sur mobile. Combinez toujours les deux pour prendre des décisions éclairées.

Les études quantitatives passent à l'échelle, vous pouvez monitorer des milliers de sessions via Hotjar ou Clarity. Les études qualitatives, elles, restent artisanales : 5 à 8 sessions par cycle. C'est cette complémentarité qui rend les tests UX aussi puissants quand ils sont bien conduits.

Toutes les méthodes ne se valent pas. Le bon choix dépend de votre stade (prototype, site en production, refonte), de votre budget et du type d'insights recherchés. Un test modéré en présentiel coûte 5 à 10 fois plus qu'un test non-modéré à distance, mais il produit des insights incomparablement plus riches. Ne confondez pas test utilisateur et focus group : l'un observe des comportements réels sur une interface, l'autre recueille des opinions déclarées dans un contexte de groupe.

L'analyse des 5 premiers résultats Google pour « tester UX » montre que la plupart des guides se contentent de lister les méthodes sans expliquer quand les se servir de ni quand les éviter. Voici les 6 méthodes les plus utilisées, classées par richesse d'insights, avec les situations précises où chacune excelle, et celles où elle ne sert à rien. Le tableau ci-dessous vous donne une vue synthétique avant d'entrer dans le détail de chaque approche.

Comparatif des 6 méthodes de test UX, budget indicatif par session avec 5 testeurs

| Méthode | Quand l'utiliser | Budget / session | Richesse insights |

|---|---|---|---|

| Test modéré présentiel | Prototype ou refonte majeure | 200-500 € | Très élevée |

| Test modéré à distance | Site en production, testeurs dispersés | 100-250 € | Élevée |

| Test non-modéré à distance | Validation rapide, itérations fréquentes | 30-80 € | Moyenne |

| Tri de cartes (card sorting) | Arborescence et navigation | 50-100 € | Moyenne |

| Test A/B | Optimisation de composants isolés | Outil seul (gratuit-200 €/mois) | Ciblée |

| Eye-tracking / heatmaps | Pages d'atterrissage, hiérarchie visuelle | Gratuit-2000 € | Élevée |

Le testeur est face à vous (ou en visio). Vous observez, posez des questions de relance, creusez les hésitations en temps réel. C'est la méthode la plus riche en qualité d'insights, chaque « pourquoi avez-vous hésité ici ? » peut révéler un problème invisible dans les analytics. Le format think-aloud (pensée à voix haute) transforme une simple observation en véritable radiographie du parcours cognitif de l'utilisateur.

Limite : ça ne passe pas à l'échelle. Cinq sessions de 45 minutes, c'est déjà une journée complète de travail entre passation, prise de notes et debriefing. Ajoutez le recrutement et l'analyse, vous êtes sur une semaine de travail. Réservez cette méthode aux refontes majeures ou aux prototypes de nouvelles fonctionnalités où chaque détail compte.

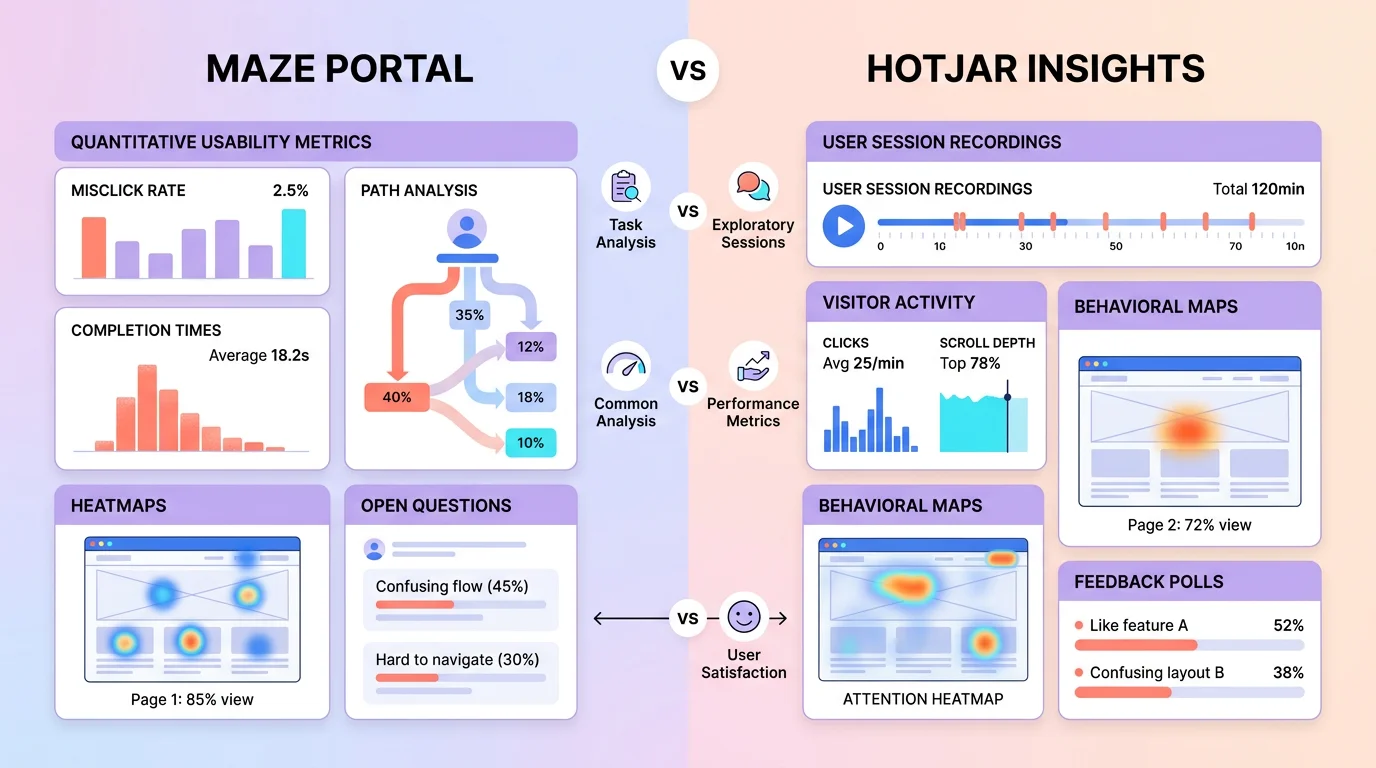

Le testeur reçoit un lien, suit les scénarios à son rythme et l'outil enregistre tout, écran, audio, clics, mouvements de souris. Vous analysez ensuite, à votre rythme. Des plateformes comme Maze ou Trymata rendent le processus quasi automatique et livrent des métriques prêtes à l'emploi.

Le compromis ? Pas de question de relance. Si le testeur bloque, vous ne saurez pas toujours pourquoi. Pour compenser, ajoutez des questions ouvertes après chaque scénario (« Qu'avez-vous trouvé frustrant ? »). C'est la méthode idéale pour itérer rapidement entre deux sprints de développement, résultats sous 48 heures au lieu de deux semaines.

Vous donnez aux testeurs des étiquettes (vos pages, vos catégories) et ils les organisent comme ils le feraient naturellement. Le résultat ? Une arborescence qui correspond à la logique de vos utilisateurs, pas à celle de votre organigramme interne. Optimal Workshop et Maze proposent des modules de card sorting intégrés. Comptez 15 à 20 testeurs pour obtenir des patterns statistiquement fiables, c'est plus que pour un test d'utilisabilité classique, mais le coût par testeur est faible car les sessions durent 10 à 15 minutes.

L'eye-tracking suit le regard du testeur sur l'écran avec un matériel spécialisé. Trop cher pour une PME ? Les heatmaps de Hotjar ou Microsoft Clarity produisent un résultat similaire à partir de données agrégées de clics et de scroll, et c'est gratuit pour les petits sites. Cette méthode excelle pour les landing pages : vous voyez immédiatement si votre proposition de valeur capte l'attention ou si le regard file directement vers le footer. L'IA commence à simuler le suivi oculaire sans matériel physique, RealEye et Attention Insight le proposent déjà à des tarifs accessibles.

Le test A/B n'est pas un test UX au sens strict, c'est un test statistique. Mais il complète les tests qualitatifs de façon redoutable, vous avez identifié un problème via un test modéré ? Déployez deux variantes de la page et mesurez laquelle convertit mieux. Google Optimize ayant fermé ses portes, les alternatives viables pour PME sont VWO (gratuit jusqu'à 50 000 visiteurs/mois) et AB Tasty. Règle d'or : ne testez qu'un seul élément à la fois, titre, CTA, disposition, sinon vos résultats seront inexploitables.

Pas de budget ? Attrapez 5 personnes dans un café, ouvrez votre site sur un téléphone et observez. Sérieusement. Steve Krug, auteur de Don't Make Me Think, recommande cette approche pour les startups et les PME sans moyens. Vous perdrez en rigueur méthodologique. Mais un test imparfait vaut infiniment mieux que pas de test du tout. Réservez 30 minutes, un café offert en échange, et vous aurez vos premiers insights sur les frictions que vos visiteurs rencontrent quotidiennement sans que vous le sachiez.

Le domaine évolue vite. Les tests d'utilisabilité se transforment grâce à trois avancées récentes. L'eye-tracking par IA (sans matériel physique) rend le suivi oculaire accessible à toutes les PME via des outils comme RealEye ou Attention Insight, résultats en quelques minutes, pas en semaines. Les outils d'analyse automatique des sessions (Microsoft Clarity, FullStory) détectent désormais les « rage clicks », les zones de frustration et les erreurs JavaScript sans configuration manuelle. Et les plateformes de test autonome alimentées par IA (Usetrace, Testim) simulent des parcours utilisateurs pour détecter les régressions fonctionnelles à chaque déploiement.

Ces outils ne remplacent pas l'observation humaine, un algorithme ne capte pas encore le soupir exaspéré d'un utilisateur face à un formulaire mal conçu. Mais ils automatisent la surveillance continue et vous alertent quand un nouveau point de friction apparaît. Pour une PME avec un site en production, la combinaison Clarity (gratuit, passif) + Maze (ponctuel, actif) couvre déjà l'essentiel du spectre.

Le piège classique : tester avec ses collègues. Ils connaissent le produit, naviguent en mode expert et ne rencontrent aucune friction. Résultat ? Zéro obstacle détecté, et un faux sentiment de sécurité qui peut coûter cher lors du lancement. Vos testeurs doivent correspondre à vos personas réels. Si vous vendez des logiciels RH à des DRH de PME, recrutez des DRH de PME. Pas des développeurs ni des stagiaires marketing. Le critère numéro un : la personne ne doit jamais avoir vu votre interface avant la session.

Le nombre dépend de la méthode. Pour un test d'utilisabilité qualitatif : 5 à 8 testeurs par profil, selon le Nielsen Norman Group (NNG, 2000). Résultat ? Pour un card sorting : 15 à 20. À retenir. Pour un test A/B : quelques milliers de visiteurs minimum pour atteindre la significativité statistique. La règle de base : commencez avec 5 testeurs. Si les 3 premiers rencontrent exactement les mêmes problèmes, vous avez déjà vos réponses. Si les résultats divergent fortement, ajoutez 3 testeurs supplémentaires pour confirmer les patterns émergents.

Trois outils couvrent la grande majorité des besoins d'une PME. Le reste, c'est du luxe ou du très spécialisé. Sélection pragmatique par usage : Maze pour les tests qualitatifs sur prototypes Figma (plan gratuit généreux, résultats structurés automatiquement), Hotjar pour le monitoring continu en production (heatmaps, replays de sessions, funnels de conversion), et Lookback pour les entretiens modérés en visio avec partage d'écran et notes synchronisées en temps réel.

Pour les budgets serrés, Microsoft Clarity mérite une mention spéciale. Gratuit, sans limite de sessions, avec une analyse IA intégrée qui détecte automatiquement les rage clicks, les retours arrière compulsifs et les zones de frustration. Pour un site WordPress ou un site vitrine, c'est un point de départ imbattable. L'outil s'installe en 5 minutes via un script ou un plugin et commence à collecter des données immédiatement, pas besoin d'attendre un panel de testeurs pour obtenir vos premières observations exploitables.

Comparatif des outils de test UX, prix indicatifs hors promotions

| Outil | Usage principal | Prix (2026) | Idéal pour |

|---|---|---|---|

| Maze | Tests non-modérés, prototypes Figma | Gratuit, 99 $/mois | PME en mode itératif |

| Hotjar | Heatmaps, enregistrements de sessions | Gratuit, 80 €/mois | Sites en production |

| Lookback | Tests modérés à distance (live) | 99 $/mois | Entretiens qualitatifs |

| Optimal Workshop | Card sorting, tree testing | Gratuit, 166 $/mois | Refontes d'arborescence |

| Microsoft Clarity | Heatmaps, replays, analyses IA | Gratuit | Budgets serrés |

| UserTesting | Panel + plateforme complète | Sur devis (à partir de 15 000 $/an) | Entreprises matures |

Vous avez conduit 5 sessions. Vous avez des heures de vidéo, des pages de notes, des heatmaps colorées. Et maintenant ? L'erreur la plus courante à ce stade : corriger ce qui vous a frappé plutôt que ce qui impacte vraiment l'utilisateur. Un biais de confirmation naturel pousse à remarquer les problèmes qui confirment vos intuitions préexistantes. La matrice de priorisation évite ce piège.

Pour chaque difficulté identifié, posez deux questions, combien de testeurs l'ont rencontré (fréquence) ? Le problème bloque-t-il la tâche ou ralentit-il simplement le parcours (impact) ? Les problèmes dans le quadrant « fréquent + bloquant » passent en priorité 1. Un menu de navigation incompréhensible pour 4 testeurs sur 5, c'est un frein direct à la conversion. Un label légèrement ambigu qui n'a gêné qu'un seul testeur ? Priorité 3 : notez-le, corrigez-le quand vous aurez le temps.

Livrez vos conclusions sous forme de rapport visuel avec captures d'écran annotées. Pour chaque problème, décrivez ce qui se passe (observation), pourquoi c'est un obstacle (impact business), et quoi faire (recommandation concrète). Un rapport de 10 problèmes priorisés vaut mieux qu'une liste de 50 observations non triées.

Un test UX ne remplace pas vos analytics. Il vous dit pourquoi les utilisateurs bloquent, pas combien sont affectés. Pour mesurer l'ampleur d'un obstacle, croisez vos observations qualitatives avec vos données Google Analytics : taux de sortie par page, entonnoir de conversion, temps sur les pages critiques. Les deux types de données se complètent, l'un sans l'autre ne raconte qu'une moitié de l'histoire.

Autre limite : les tests UX fonctionnent pour des parcours définis, avec des tâches à accomplir. Si votre site a un obstacle de proposition de valeur (les visiteurs comprennent votre offre mais ne sont pas intéressés), aucun test d'utilisabilité ne le détectera. C'est un difficulté de positionnement marketing, pas d'interface.

Cette approche excelle pour les sites où l'utilisateur a une mission, e-commerce, SaaS, formulaires de devis. Elle est moins pertinente pour les sites purement éditoriaux ou les portfolios, où l'interaction se limite à la lecture et au scroll. Dans ces cas, les heatmaps et les données de profondeur de scroll suffisent généralement à optimiser la mise en page.

Méfiez-vous aussi des biais de complaisance, en présentiel, certains testeurs évitent de critiquer par politesse. Précisez toujours en début de session : « Vous ne testez pas vos compétences, vous testez notre produit. Plus vous êtes critique, plus vous nous aidez, » Cette simple phrase transforme la dynamique de la session.

Imaginez une boutique en ligne de produits artisanaux, 200 visiteurs/jour, un taux de conversion jugé faible. L'équipe soupçonne un point de friction sur le tunnel d'achat mais n'a aucune certitude. Ils lancent 5 tests non-modérés via Maze, coût total : 200 € (5 testeurs compensés 40 € chacun en bon d'achat). La préparation prend une demi-journée : 3 scénarios centrés sur la découverte produit, l'ajout au panier et le paiement.

Résultat : 4 testeurs sur 5 ne trouvent pas l'option « retrait en magasin », cachée dans un sous-menu du checkout. Un testeur abandonne le panier parce que les frais de livraison apparaissent uniquement à la dernière étape, un classique identifié par le Baymard Institute (2024) comme une cause majeure d'abandon de panier. Deux corrections, une demi-journée de développement. Le type de friction que les analytics seuls ne peuvent jamais expliquer avec certitude.

Avant de lancer votre premier test, assurez-vous que votre design UX repose sur des fondations solides. Un test sur un site sans architecture cohérente ne produira que du bruit, vous trouverez des dizaines de problèmes superficiels sans identifier les vrais blocages structurels. Commencez par auditer votre parcours principal dans Google Analytics : identifiez les 3 pages où vos visiteurs décrochent le plus (taux de sortie élevé), puis construisez vos scénarios de test autour de ces points de friction. C'est là que chaque session de test aura le plus d'impact sur vos conversions.

Pensez aussi au timing. Quand lancer vos tests ? Avant une refonte (pour identifier ce qui fonctionne et ce qui ne fonctionne pas), pendant le prototypage (pour valider les choix de conception) et après le lancement (pour vérifier que les corrections ont eu l'effet escompté). Un cycle de test complet, de la préparation à l'analyse, prend entre 1 et 3 semaines selon la méthode choisie et la réactivité de vos testeurs.

Nos experts UX construisent des protocoles de test adaptés à votre audience et vos parcours critiques. Résultats en 2 semaines, recommandations priorisées, plan d'action concret.

Pour aller plus loin, consultez notre guide sur l'expérience utilisateur pour comprendre les principes fondamentaux qui sous-tendent chaque test réussi. Si vous envisagez une refonte complète de votre interface, découvrez comment un consultant UX structure une démarche de recherche utilisateur du brief initial jusqu'aux recommandations finales, et comment intégrer les résultats de vos tests dans un plan de refonte cohérent.

Les tests UX ne sont pas une étape ponctuelle dans un projet. C'est une pratique continue qui s'améliore avec chaque cycle. Votre premier test sera imparfait, et c'est normal. Le deuxième sera plus ciblé, le troisième plus rapide. Ce qui compte, c'est de commencer. Cinq testeurs, un après-midi, un formulaire de notes : vous en savez déjà plus sur vos utilisateurs que la plupart de vos concurrents. Ouvrez Maze ou Clarity dès aujourd'hui, rédigez vos 3 scénarios prioritaires et lancez votre première session cette semaine. Les résultats vous surprendront.

Derniere mise a jour : Avril 2026

Un test UX (test d'utilisabilité) consiste à observer de vrais utilisateurs réaliser des tâches sur votre site ou prototype. L'objectif est d'identifier les frictions, les incompréhensions et les points de blocage avant qu'ils n'impactent vos conversions. Contrairement à un sondage ou un focus group, le test UX mesure des comportements réels, ce que l'utilisateur fait, pas ce qu'il dit qu'il ferait. Cinq testeurs suffisent à détecter la majorité des problèmes.

Les 4 niveaux de test UX correspondent à la maturité du produit : 1) Test exploratoire (phase de recherche, avant toute maquette, interviews, card sorting), 2) Test de concept (wireframes ou prototypes basse fidélité, validation de l'architecture), 3) Test d'utilisabilité (prototype haute fidélité ou site en développement, parcours complets), 4) Test de validation (site en production, mesure de performance, A/B testing). Chaque niveau répond à des questions différentes et emploie des méthodes adaptées.

Trois approches gratuites fonctionnent. Le test guérilla : demandez à 5 personnes dans un café ou un coworking de réaliser une tâche sur votre site (offrez un café en échange). Microsoft Clarity : installez cet outil gratuit pour obtenir des heatmaps et des replays de sessions sans limite. Le test entre pairs : échangez des tests avec d'autres PME de votre réseau, vous testez leur site, ils testent le vôtre. L'essentiel est de tester avec des personnes qui ne connaissent pas votre produit.

Le coût varie selon la méthode. Test guérilla : quasi gratuit (un café par testeur). Test non-modéré via Maze : 150 à 400 € pour 5 testeurs (outil gratuit + compensation testeurs). Test modéré par une agence UX : 3 000 à 9 000 € pour un cycle complet (recrutement, passation, analyse, rapport). Pour une PME qui débute, un budget de 200 à 500 € pour un premier cycle de 5 tests non-modérés est un investissement raisonnable, souvent amorti dès les premières corrections.

Le Nielsen Norman Group recommande 5 testeurs par profil utilisateur pour un test qualitatif. Ce chiffre détecte environ 85% des problèmes d'utilisabilité selon l'étude fondatrice du NNG. Au-delà de 8, chaque testeur supplémentaire apporte peu de découvertes nouvelles. Exception : le card sorting nécessite 15 à 20 participants pour des patterns statistiquement fiables, et les tests A/B demandent des centaines voire des milliers de visiteurs pour atteindre la significativité statistique.

L'audit UX est une évaluation experte : un spécialiste analyse votre interface selon des heuristiques reconnues (les 10 principes de Nielsen, par exemple) sans impliquer d'utilisateurs. Le test UX implique de vrais utilisateurs qui interagissent avec votre site. Les deux sont complémentaires : l'audit identifie les problèmes « évidents » à moindre coût, le test révèle les frictions invisibles que seul un utilisateur réel peut rencontrer. Commencez par un audit, puis validez avec des tests.

UserTesting rémunère ses testeurs entre 4 et 10 dollars par test pour les sessions non-modérées de 15 à 20 minutes. Les sessions modérées (entretiens en visio de 30 à 60 minutes) rapportent entre 30 et 120 dollars selon la complexité et le profil recherché. Les paiements sont versés via PayPal sous 7 jours. D'autres plateformes comme Trymata (environ 10 $ par test) et Testbirds offrent des rémunérations similaires. Devenir testeur UX n'est pas un revenu principal, mais un complément ponctuel.

Pour un site e-commerce ou SaaS en croissance, visez un cycle de tests par trimestre. Après chaque refonte majeure ou ajout de fonctionnalité, lancez un test ciblé sur les parcours modifiés. En complément, les outils de monitoring continu (Hotjar, Clarity) tournent en permanence et vous alertent quand un nouveau point de friction apparaît. La règle : ne lancez jamais une refonte sans tester avant (l'existant) et après (le nouveau).

Le Lean UX remplace les livrables lourds par des cycles courts de validation. Découvrez comment appliquer cette méthode à vos projets web pour livrer plus vite et réduire le gaspillage.

Le consultant UX analyse vos parcours utilisateurs, identifie les frictions et conçoit des interfaces qui convertissent. Découvrez ses missions, ses compétences clés et les tarifs pratiqués en 2026.

Role du consultant user experience : missions, competences, tarifs et methode UX pour transformer vos parcours digitaux en leviers de conversion.

Réservez votre audit stratégique gratuit de 30 minutes.

On analyse votre site et on vous propose un plan d'action concret.